LLM・RAG・ChatGPT/Geminiは混同されがちだが、指しているものは別レイヤー。

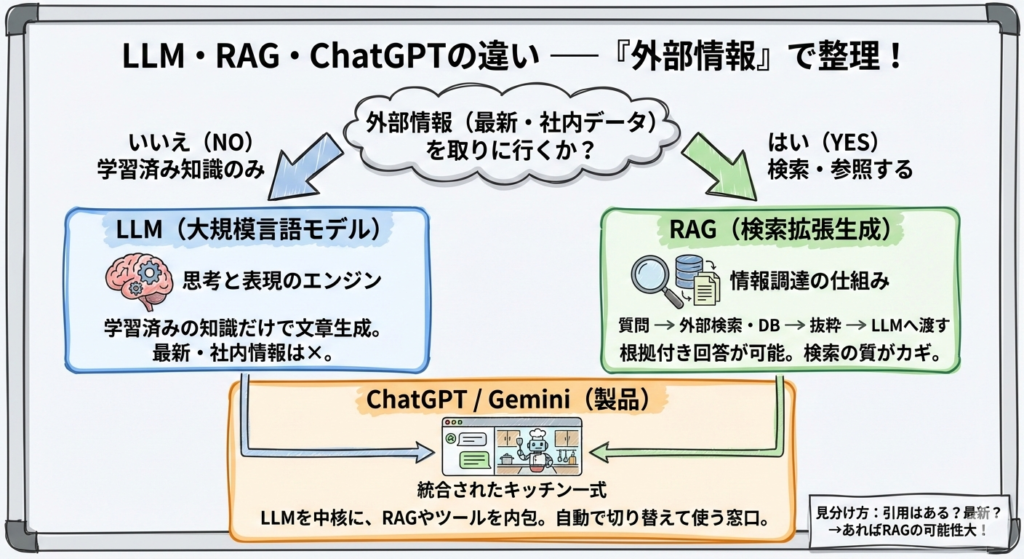

結論から言うと、LLMは基盤技術(エンジン)、RAGは外部情報で補強する方式、ChatGPT/Geminiはそれらを統合した製品である。

まずLLM(大規模言語モデル)は、膨大なテキストで訓練された言語モデルそのもの。GPT-5.2やClaude、Llamaなどがこのカテゴリで、文章生成・要約・推論といった能力の中心にある。ただしLLM単体は、基本的に外部の最新情報や社内資料を取りに行かない。与えられた入力(プロンプトや会話履歴)と学習済み知識の範囲で答えを作る。

次にRAG(Retrieval-Augmented Generation)は、LLMを拡張するための技術手法。

質問を受けたら、検索やデータベース、社内ドキュメントなどの外部知識源から情報を取得し、その抜粋をコンテキストとしてLLMに渡して回答を作る。RAGの本質は、LLMの弱点(最新情報不足、社内情報に触れない等)を情報取得の工程で補う点にある。反面、検索が外れると回答も外れやすく、取得品質が生命線になる。

そしてChatGPT/Geminiは、LLMを使って作られた製品・サービス。ユーザーインターフェース、履歴、ツール連携などを含む完成品であり、内部では必要に応じてRAGや各種ツールを組み合わせる。同じ入力欄でも、状況によって「LLMのみ」か「外部取得あり」かが切り替わるため、ユーザー目線では境目が見えづらくなる。

ここで「API叩く」という感覚が効いてくる。一般にその感覚は、RAGや製品側が外部に問い合わせる工程を指していることが多い。検索API、社内DB、ストレージ、別サービスなどにアクセスして材料を集め、それをLLMに渡す——この外に取りに行く動きがまさにそれ。補足すると、LLM自体も推論の呼び出しはAPIで行われることがあるが、重要なのは「LLMが外へ取りに行く」のではなく、周辺の仕組み(RAG/製品)が外部APIを叩いて情報を集めるという点。

整理すると、LLMは頭脳、RAGは調査(外部取得)、ChatGPT/Geminiはそれらを統合した窓口だ。このレイヤー分けを押さえれば、「なぜ社内資料は設定が必要か」「なぜ最新情報に強い時と弱い時があるか」も一貫して説明できます。